VPN и Kubernetes без боли: sidecar, policy, mesh и живые кейсы, которые реально работают

Содержание статьи

- Зачем нам vpn в контейнерных средах в 2026 году

- Docker и vpn: базовые паттерны и типовые грабли

- Sidecar-паттерн: vpn как сайдкар у pod

- Kubernetes network policies: от базовой изоляции до тонкой фильтрации

- Service mesh и vpn: кто за что отвечает

- Архитектуры vpn для kubernetes: выбираем осознанно

- Практические кейсы: от sftp до multi-cloud и ci

- Наблюдаемость, перфоманс и отладка: без этого никуда

- Безопасность: секреты, ключи, доступы

- План внедрения: по шагам, без хаоса

- Оптимизация производительности: простые шаги, ощутимый эффект

- Отладка инцидентов: короткий чек-лист

- Частые ошибки и как их избежать

- Мини-шпаргалка по выбору решений

- Faq

Зачем нам VPN в контейнерных средах в 2026 году

Контейнеры ускоряют всё, но сеть — ахиллесова пята

Вы уже развернули микросервисы, всё летает, а потом внезапно падает сеть к приватным ресурсам. Больно. В 2026 году мы живем в мультиоблачной реальности: кластеры Kubernetes в разных регионах, приватные API у партнеров, корпоративные базы за брандмауэром, а ещё требования регуляторов. Без безопасного и предсказуемого канала связи не обойтись. VPN — это не просто туннель, это гарантированный коридор, где нам никто не мешает и где мы сами управляем правилами.

Контейнеры меняют подход к VPN: нам нужны автоматизация, изоляция, хитрые схемы маршрутизации и интеграция с политиками. Случайные костыли работать перестали: мы либо делаем системно, либо осложняем жизнь себе и команде поддержки. Хорошая новость: у нас уже есть проверенные паттерны, которые масштабируются легко и не ломают DevOps-процессы.

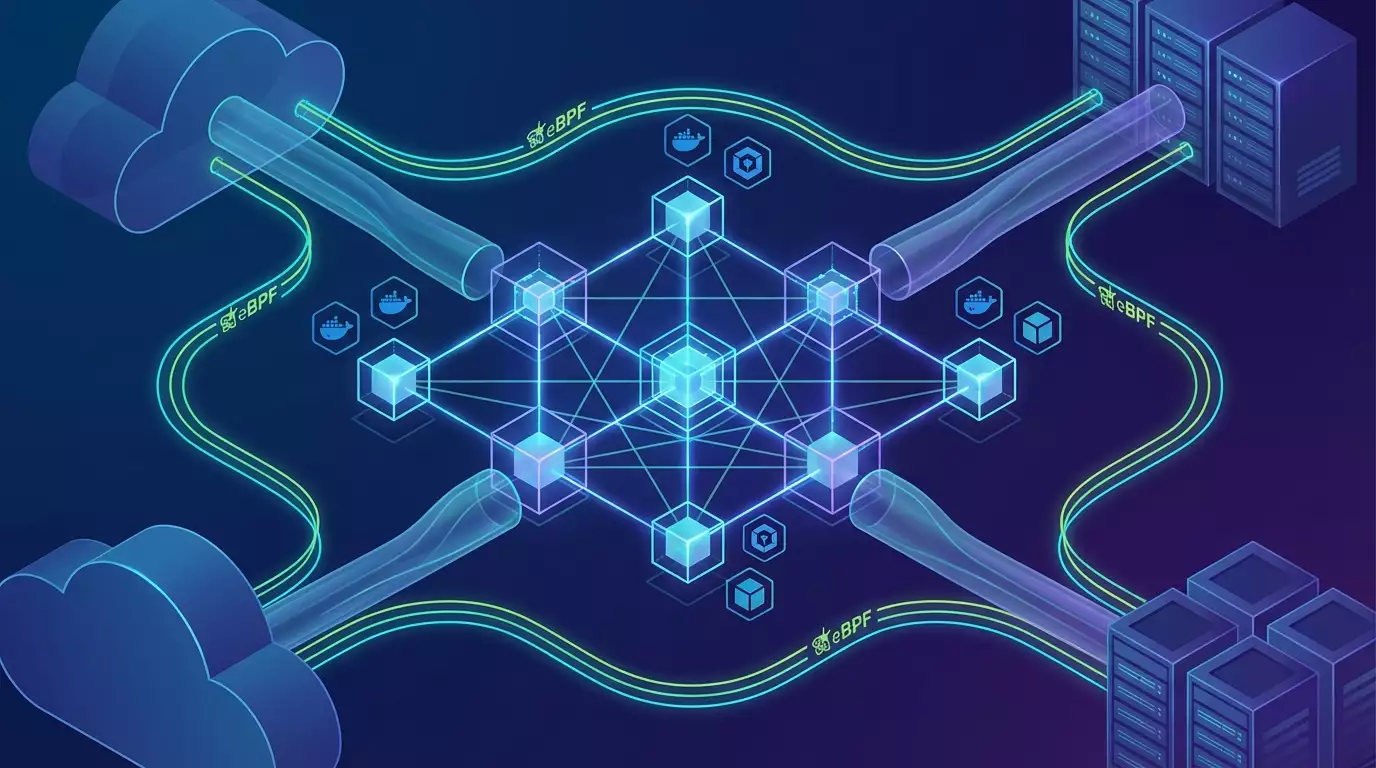

Тренды 2026: eBPF, sidecarless data plane и Zero Trust

В 2026 мы видим зрелость eBPF в продакшене: сетевые пулы ускоряются без iptables-мешанины, наблюдаемость стала глубже, а политики — тоньше. Заметен дрейф в сторону sidecarless-сетевых плоскостей для mesh, но классический sidecar никуда не делся: он по-прежнему удобен там, где нам нужен локальный VPN и простая изоляция трафика. Zero Trust уже не лозунг, а набор практик: mTLS внутри, туннели наружу, аутентификация каждого прыжка.

И важный нюанс: командам удобнее управлять сетью из GitOps. Политики, туннели, ключи, маршруты — всё в коде, с проверкой и аудитом. Это не только красиво, это снижает риски человеческого фактора.

Регуляции и экономия: два драйвера, которые ускоряют внедрение

Регуляторы просят контролировать данные по регионам, логировать соединения, обосновывать маршрутизацию. VPN с корректными политиками позволяет отчитываться и уверенно проходить аудит. Плюс экономия: грамотно спланированный туннель и mesh заменяют дорогие выделенные линии, а оптимизированные маршруты снижают latency без закупки лишнего железа. Просто и эффективно.

Docker и VPN: базовые паттерны и типовые грабли

Контейнерный VPN-клиент: быстро и изолированно

Простейший способ — вынести VPN-клиент (например, WireGuard или OpenVPN) в отдельный контейнер. Мы даем ему нужные capabilities (NET_ADMIN, SYS_MODULE при необходимости, хотя лучше без последнего) и поднимаем интерфейс в namespace контейнера. Другие контейнеры приложения подключаются к нему через общий Docker network или через network namespace-шаринг.

Плюсы: быстрая упаковка, предсказуемая конфигурация, легко масштабировать. Минусы: нужно аккуратно настраивать маршруты и DNS, иначе вы получите «едем через VPN всегда», даже там где не надо. Мы обычно выбираем split-tunneling: только приватные подсети и хосты уходят в туннель, остальное — напрямую.

Split-tunneling и политика DNS

Split-tunneling — это не роскошь, а необходимость. Если у вас CI скачивает образы из публичного реестра, не тяните всё через VPN, иначе скорость упадет, а счёт за трафик вырастет. Ключ: таблицы маршрутизации с приоритетами и корректные правила для доменов. Для DNS используйте локальный резолвер в контейнере VPN или sidecar, чтобы приватные зоны шли в нужный upstream, а публичные — в обычные.

Частая ошибка: смешать порядок резолверов. Итог — периодические таймауты, «иногда работает». Мы рекомендуем явные списки split-DNS и явные доменные суффиксы, плюс healthchecks для контрольных доменов.

Docker Compose: минимально, но жизнеспособно

В Compose можно объявить сервис vpn с cap_add NET_ADMIN, смонтировать конфиги, запустить WireGuard и зашарить сеть с app через network_mode: service:vpn или подключить оба сервиса к одному бриджу и прописать маршрут через vpn. Рабочий вариант: готовые плагины не обязательны, важнее тщательная настройка шлюза по умолчанию и исключений. Опять же — split-туннели и проверка DNS.

Практика показывает: если вы изначально пропишете health-probe для VPN (например, пинг до приватного хоста) и hook для graceful shutdown, то получите предсказуемое поведение при деплое и обновлениях. Мелочь, а экономит часы.

Sidecar-паттерн: VPN как сайдкар у Pod

Зачем вообще сайдкар, ведь есть DaemonSet

Sidecar — это приватный телохранитель вашего сервиса. Он живет рядом в том же Pod, делит network namespace (если так сконфигурировано), поднимает туннель и фильтрует трафик локально. Поддержка проста: изолируете трафик одного сервиса от другого, настраиваете тонкую политику, не трогаете узловой хост. Да, можно поднять общий VPN в DaemonSet, но тогда маршрутизация сложнее и безопасность чуть размазывается.

Sidecar хорош, когда сервис критичен к приватным API или требует индивидуальных маршрутов. Например, платежный микросервис или интеграция с партнёром по SFTP. Сайдкар включает туннель, обслуживает только своего соседа и не светит конфиги наружу.

Маршрутизация и iptables без фокусов

Схема простая: init-контейнер sidecar создает wg0 или tun0, прописывает в таблицы маршрутизации сети назначения, отмечает пакеты iptables mangle, чтобы принудительно отправлять нужные CIDR в туннель. Приложение работает как обычно, но его egress по приватным адресам уходит через VPN. Для ingress можно при желании аналогично ограничить источники, но чаще VPN нужен на egress.

Совет: держите список сетей в ConfigMap и версионируйте его через GitOps. Хотите быстро расширить приватку — коммитите изменение, ArgoCD или Flux подтянут, sidecar перезапустится, готово. Как по маслу.

InitContainers и подготовка среды

InitContainers удобны для прогрева маршрутов, загрузки ключей, проверки доступности шлюзов. Мы часто делаем так: init скачивает и верифицирует ключи из секрет-хранилища, валидирует конфиги, пингует контрольный IP через туннель с коротким таймаутом. Если всё ок — запускаем основной sidecar и приложение. Если нет — падаем быстро, чтобы автохилер перезапустил Pod и не держал полузомби.

Kubernetes Network Policies: от базовой изоляции до тонкой фильтрации

Calico, Cilium и eBPF ускоряют политику

Политики — это ваш сетевой ремень безопасности. Calico и Cilium давно стали стандартом де-факто. В 2026 всё чаще выбирают eBPF-путь, потому что он быстрее и гибче, чем iptables, плюс позволяет богатую телеметрию без массивных оверхедов. Однако не гонитесь за модой: если у вас стабильный Calico c iptables и понятные правила, не надо ломать всё ради галочки. Придет время — мигрируете планово.

Главная мысль: NetworkPolicy ограничивает, кто к кому ходит и куда уходит egress. Мы сочетаем её с VPN-сайдкаром: default deny, а затем добавляем правила на egress только к приватным сетям через sidecar. Эта комбинация резко снижает поверхность атаки.

Egress-политики и DNS

Не забывайте, что egress-политики не работают по доменам, только по IP/подсетям. Для доменных приватных зон используйте split-DNS и фиксируйте резолв через локальный резолвер в Pod. Либо прикручивайте egress-gateway (mesh), где можно применить политики на уровне L7 с привязкой к SNI. Если у вас много FQDN, egress-gateway часто удобнее: меньше мучений с IP-листами, которые живут своей жизнью.

Multi-tenant пространства имён

В multi-tenant-кластерах без жестких NetworkPolicy любой студент может случайно постучаться к соседу. Мы обычно включаем шаблон: default deny на ingress и egress в каждом namespace, сетевые профили для групп сервисов и изолированные egress через VPN-сайдкар. Плюс отдельный namespace для общих шлюзов, куда доступ разрешен только из определенных пространств. На практике это выглядит скучно. Но работает железно.

Service Mesh и VPN: кто за что отвечает

mTLS внутри, VPN наружу

Mesh решает межсервисное шифрование и наблюдаемость внутри кластера: mTLS, retries, timeouts, метрики. VPN закрывает внешний коридор — к партнерам, приватным регионам, дата-центрам. Не путайте инструменты. В 2026 многие перешли на Gateway API и egress-gateway для контроля исходящего L7-трафика. Это удобно: политики на домены и пути, авторизация по JWT, трейсинг из коробки.

Комбинация такая: внутри — mesh с mTLS, снаружи — VPN до нужных сетей, а затем egress-gateway, который применяет L7-политику и маршрут. В результате мы точно знаем, кто и куда ходит, и можем быстро резать доступ без затрагивания приложения.

Istio, Linkerd и sidecarless-тенденции

Да, sidecarless-подход набирает обороты, снижает оверхед и упрощает траблшутинг. Но при VPN он не всегда удобен, потому что нам нужен локальный туннель и маршрутизация рядом с приложением. Мы часто видим гибрид: mesh управляет политиками и телеметрией, а VPN живет либо в sidecar, либо в узловом агенте, если требуется общий туннель. Важно не увязнуть в догмах. Делайте так, как проще поддерживать конкретно вашей команде.

Egress-gateway и L7-политики

Когда приватный ресурс доступен по HTTPS с SNI, вы выгоды ощущаете в полный рост. Egress-gateway позволяет привязать разрешения к доменному имени и пути. Даже если IP плавает, политика остается валидной. А дальше — туннель на уровне сети. Так вы закрываете два уровня рисков: IP-уровень через VPN и L7-уровень через mesh. Дорого? Нет. Просто по-взрослому.

Архитектуры VPN для Kubernetes: выбираем осознанно

Hub-and-spoke: проще, чем кажется

Классика: центральный хаб (в дата-центре или облаке), а от него спицы в регионы и кластеры. Преимущества — предсказуемость и простое управление ключами. Недостаток — возможный bottleneck и дополнительная задержка. В продакшене мы нередко добавляем второй хаб, делаем health-based failover и привязываем маршруты к ближнему хабу по географии или ASN.

Full mesh VPN: когда нужен прямой путь

Если у вас много регионов и латентность — боль, тогда прямые туннели между кластерами решают. Да, сложнее ключи, сложнее нейминг и больше пересечений. Но если ваш SLA — десятки миллисекунд, другого пути нет. В 2026 это упрощают оркестраторы ключей и автоматическая генерация конфигураций на базе GitOps. Да, магии нет, но рутина становится терпимой.

Zero Trust: не доверяй, проверяй

Zero Trust в контексте VPN — это не «один жирный туннель на весь мир», а проверка личности и полномочий на каждом шаге: device posture, короткоживущие ключи, явная авторизация по политике, логирование каждого запроса. VPN здесь — транспорт, а решения об авторизации — выше, в mesh и в брокерах доступа. Лаконично, но очень по делу.

Практические кейсы: от SFTP до multi-cloud и CI

Стабильный доступ к приватному API партнера

Задача: безопасно дотянуться до API партнера, у которого whitelisting по IP и строгий rate limit. Решение: sidecar с WireGuard, split-tunnel только к CIDR партнера, egress-policy на namespace, а в mesh — отдельный egress-gateway с лимитами и ретраями. Результат: стабильные 150-200 мс, нулевые timeouts, гибкая настройка лимитов. Поддержка довольна.

Multi-cloud репликация

Два облака, два кластера, одна база реплицируется по приватным сетям. Мы ставим hub в центральном регионе, строим spoke-туннели к кластерам. Внутри — NetworkPolicy default deny, разрешаем репликацию по портам, трафик идёт через VPN. На mesh включаем mTLS и retry-стратегии, чтобы кратковременные просадки не ломали стрим. В пик нагрузок latency растет на 5-7 мс, терпимо и предсказуемо.

CI/CD и приватные артефакты

Runner в Kubernetes часто страдает: ему надо достучаться до приватного Nexus или Git-сервера. Мы добавляем сайдкар с туннелем, в init прогреваем DNS и роуты, egress-политикой блокируем всё лишнее. В результате сборки стабильно скачивают зависимости, а утечки наружу исключены. И да, прописывайте явный список хостов: это сэкономит вам выходные.

Наблюдаемость, перфоманс и отладка: без этого никуда

Метрики, которые реально полезны

Мы собираем RTT до шлюзов, потери пакетов на туннеле, процент пакетов через VPN vs прямой канал, ошибки handshakes, время DNS-резолва приватных зон. Плюс базовые системные: CPU/ памяти у sidecar, дескрипторы, очереди. Звучит скучно. Но когда что-то падает, именно эти метрики покажут, где копать.

Логи и трассировки

Логи VPN-клиента — в общий стек логирования с маскированием ключей. Трассировки на уровне приложения в mesh: видим, где залип запрос, какой hop дал 429, а где всё ок. Удобно сопоставлять spike latency с графиком packet loss на туннеле. Когда корреляция очевидна, спорить уже не о чем.

eBPF и профилирование трафика

eBPF-агенты помогают увидеть, какие потоки реально ходят через VPN, а какие — мимо. Это бесценно для ревью политик: вы быстро обнаружите «серых кардиналов» — сервисы, которые внезапно тянут трафик во внешние сети. Правите политику, жмете apply, проверяете метрики — и живете спокойно.

Безопасность: секреты, ключи, доступы

Хранение секретов без нервов

Ключи и конфиги VPN — только в секрет-хранилищах: Kubernetes Secrets с KMS-шифрованием, внешние хранилища вроде Vault или облачные секрет-менеджеры. Никаких ключей в образах. Никаких ключей в Git. Да, звучит как капитан очевидность. Но поверьте, мы видели всякое.

Ротация ключей и короткая жизнь токенов

Ключи должны жить недолго: автоматическая ротация, оповещения за N дней до истечения, failover через второй туннель, чтобы обновления не роняли прод. Делайте blue-green для конфигов VPN: новый ключ, проверка, переключение, удаление старого. Расщепляйте права: кто-то может читать, но не писать. Просто и безопасно.

Pod Security и rootless-контейнеры

По возможности запускайте VPN-клиенты в rootless-режиме, без лишних capabilities. Если нужен NET_ADMIN — дайте ровно на init и заберите потом. Используйте Pod Security Standards и ограничивайте всё, что можно. Чем меньше доверия к самому контейнеру, тем спокойнее ночной сон.

План внедрения: по шагам, без хаоса

Аудит целевого трафика и карты потоков

Начните с инвентаризации: какие сервисы, куда ходят, какие домены и подсети, какие порты, какой SLO. Нарисуйте карту потоков. Часто уже на этом этапе всплывают удивительные вещи. Не ругайте команду — просто зафиксируйте как есть.

Выбор паттерна и пилот

Если сервисов мало и требования простые — sidecar. Если нужен общий периметр — DaemonSet или узловой агент. Если много доменных политик — egress-gateway плюс mesh. Ставьте пилот в одном namespace, включайте метрики, мониторьте неделю. Затем масштабируйте по блокам, а не всем скопом.

GitOps и контроль изменений

Все политики, маршруты, конфиги — в репозитории. Любое изменение — через PR и ревью. Артефакт — проверяемый манифест, который накатывается CD-системой. Это убирает случайные правки и создает историю: кто, когда и зачем. Особенно это ценят аудиторы и ваша же команда через полгода.

Оптимизация производительности: простые шаги, ощутимый эффект

MTU, MSS и чёрная магия пакетов

Часто проблемы в MTU. Проверьте path MTU discovery, настройте MSS clamping на туннеле, чтобы избежать фрагментации. Простой тест: iperf через туннель с разным размером пакета и наблюдение за потерями. В 9 случаях из 10 легкая правка MSS избавляет от «всё тормозит по вечерам».

CPU и криптография

WireGuard быстрый, но шифрование ест CPU. Дайте sidecar vCPU побольше, включите аппаратные инструкции, не загоняйте его на тот же узел, где тяжелая Java. Балансируйте. А ещё — держите пару резервных туннелей с меньшим приоритетом маршрута, чтобы не упираться в один choke point.

Кэширование DNS и warm-up

Локальный кэш DNS в Pod плюс предварительный прогрев критичных доменов снижают пиковые задержки. Дёшево и эффективно. И да, прописывайте TTL разумно, иначе вы будете ругаться с кешем при каждом изменении записей.

Отладка инцидентов: короткий чек-лист

Сначала простое

Пингуем шлюз, смотрим reachability. Проверяем, что маршрут для приватных сетей смотрит на интерфейс туннеля. Проверяем DNS: куда резолвится домен, кто отвечает, какие таймауты.

Потом глубже

Смотрим логи VPN, сверяем handshakes, ключи и время жизни. Смотрим eBPF-телеметрию потоков: куда реально побежали пакеты. Смотрим mesh-трассировки: на каком шаге рвется цепочка.

И, если что, откатываемся

GitOps спасает: откат на предыдущий рабочий набор политик и конфигов за минуту. Без «а что там было изменено». Без паники. У всех выдох. Потом спокойно разбираем root cause.

Частые ошибки и как их избежать

Туннель «на все случаи жизни»

Желание протащить вообще весь трафик через один жирный VPN похвально, но нерационально. Split-туннели, доменные правила на egress и разные профили для разных сервисов — вот наш путь. Удобнее, быстрее, безопаснее.

Игнорирование DNS

DNS — тихий саботажник. Проверьте порядок резолверов, используйте локальный кэш, сегментируйте приватные зоны. Если DNS тупит, мне даже не интересно, какие у вас политики — всё равно будет «иногда не работает».

Без показателей нет управления

Без метрик вы летите вслепую. Добавьте обязательные дашборды: туннель жив, потери низкие, latency в норме, CPU хватает. Потом вы скажете себе спасибо.

Мини-шпаргалка по выбору решений

Если у вас один чувствительный сервис

Берем sidecar, split-туннели, строгую egress-policy. Плюс базовые метрики и алерты. Просто и надежно.

Если у вас десятки сервисов с доменными правилами

Добавляем service mesh с egress-gateway, L7-политики по SNI, а VPN используем как транспорт до приватных сетей. Управление через GitOps, секреты — во внешнем хранилище.

Если у вас много регионов и нужен низкий latency

Full mesh между кластерами с автоматизацией ключей, локальные хабы, политика маршрутизации по близости. Тщательно смотрим на MTU и CPU профили.

FAQ

Можно ли обойтись без sidecar и сделать один общий VPN на узле

Можно, и это упростит операционку. Но вы потеряете изоляцию на уровне Pod и гибкость маршрутов. Для простых сценариев годится, для чувствительных — лучше sidecar.

Стоит ли переходить на eBPF немедленно

Если текущие политики стабильно работают и нет проблем с производительностью, переходите планово. eBPF дает профит, но не нужно ломать то, что и так летает. Держите пилот и мигрируйте постепенно.

Что выбрать: WireGuard или OpenVPN

WireGuard быстрее и проще, отличная производительность. OpenVPN гибче в некоторых enterprise-сценариях. В 80 процентов случаев мы выбираем WireGuard. Но смотрите на ваши требования и совместимость.

Как контролировать доступ по доменным именам, если NetworkPolicy про IP

Используйте egress-gateway в service mesh. Он работает на L7, понимает SNI и может применять политики по доменам и путям. Это нормальная связка с VPN-транспортом.

Где хранить ключи VPN

В секрет-хранилищах: Kubernetes Secrets с KMS, Vault, облачные Secret Manager. Никаких ключей в образах и репозиториях. Настройте ротацию и аудит доступа.

Как обезопасить DNS

Локальный кэш в Pod, явные приватные зоны, разделение резолверов для внутренних и внешних доменов. Плюс метрики резолва и алерты по таймаутам. Так вы избежите «мистических» сбоев.

Нужен ли нам Zero Trust, если уже есть VPN

Да, потому что VPN — это транспорт. Zero Trust — про идентичность, авторизацию на каждом шаге и минимально необходимые права. В паре они дают реальную устойчивость и прозрачность.